南京大数据培训班

南京大数据培训班

- 上课时段:详见详情

- 教学点:1个

- 开班时间:滚动开班

- 课程价格:请咨询

- 已关注:748

- 优惠价格:请咨询

- 咨询电话: 400-008-6280

- 微信咨询:tan4811

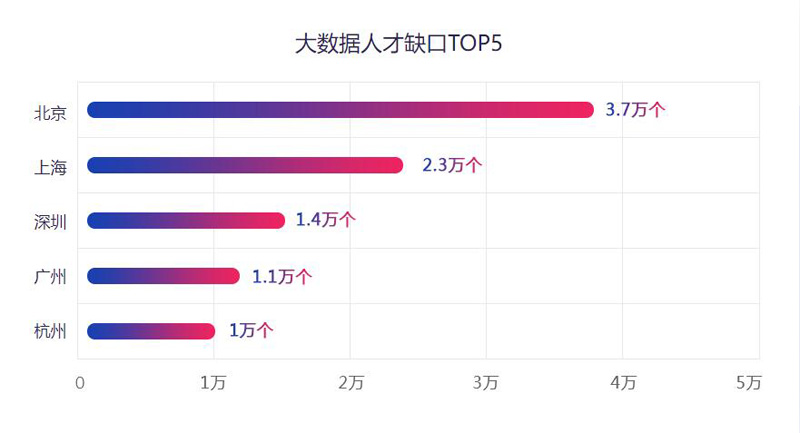

大数据是一种在获取、存储、管理、分析等方面大大超出了传统数据库软件工具能力范围的数据集合。它具有大量的数据规模、快速的数据流转、多样的数据类型和价值密度低四大特征。 未来大数据相关人才缺口巨大。

大量优质岗位等你来

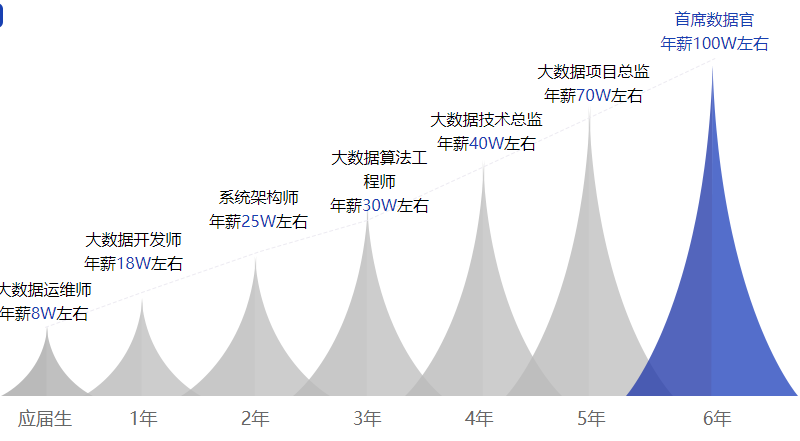

薪资待遇随工作年限呈阶梯式上涨

只有想不想学,没有能不能学

理论、实战双向并行,奠定入行扎实基础

第一阶段 Java语言基础 | Java语言基础: Java语言入门、基本语法、面向对象、常用API、异常、集合、IO流、多线程、网络编程、反射、JDK新特性、MySQL数据库、JDBC 培养方向: 了解Java语言的特征和应用领域;掌握JDK、JRE和JVM的作用;能够成功搭建Java开发环境;完成HelloWorld程序的编写;掌握IDE工具IDEA的使用方式; 掌握Java基本语法中的常量、变量的声明和使用;掌握Java中的运算符、数据类型及其相互转换;掌握分支结构、循环结构、方法的定义和使用;掌握数组的使用,理解数组的内存结构; 掌握面向对象的编程思想;掌握类和对象的定义和使用;理解封装、继承、多态等特性;掌握抽象类、接口的特点和使用方式;充分理解并运用Java面向对象思想来进行程序开发; 掌握Java中的常用类和工具类的使用,能够使用这些常用类和工具类解决多种问题; 掌握Maven项目构建和依赖管理、掌握Maven的继承和聚合; |

第二阶段 Hadoop技术栈 | Hadoop技术栈 Linux、Hadoop、ZooKeeper、Hive、HBase、海王星大数据金融平台 培养方向: 掌握Linux操作系统安装及常用命令;掌握shell脚本编程; 掌握大数据架构Hadoop原理及编程应用;掌握Hadoop三大组件的使用方式、方法以及Hadoop调优; 掌握ZooKeeper协管理器工作机制以及动态感知原理及使用; 掌握Hive数据仓库的使用及调优原理; 掌握HBase数据库的开发、使用以及调优; 掌握消费金融业务处理流程;掌握根据业务制定合理技术框架(技术选型)的能力;大量数据的日志采集方案;数仓的分层搭建以及数仓建模;掌握大量数据的ETL处理方式;掌握工作流调度解决方案;掌握即席查询工具使用及其原理;掌握数据可视化报表工具的使用;掌握数据治理框架的原理以及使用;掌握集群指标监控工具的使用 职业方向: Hadoop开发工程师、数据仓库工程师、ETL开发工程师、离线开发工程师 |

第三阶段 Spark技术栈 | Spark技术栈 Scala、Kafka、Spark、交通流量实时可视化大屏 培养方向: 掌握Scala基本语法和进阶的使用,为学习Spark、Flink框架打下基础; 掌握消息队列概念、Kafka原理架构、日志合并、消息检索; 掌握分布式内存计算、RDD、DataSet、DStream概念; 掌握离线计算、流式计算; 掌握可视化大屏内在价值与用途;掌握实时流数据分析业务处理流程;掌握Flume+Kafka+Sparkstreaming+Redis架构整合;掌握Springboot的使用;掌握websocket操作使用;了解Echarts的使用方式 职业方向: Spark开发工程师、实时开发工程师 |

第四阶段 Flink流式处理框架 | Flink流式处理框架: Flink、ClickHouse、畅游天涯旅游实时分析项目 培养方向: 掌握Flink的原理;掌握Flink的使用以及与其他技术的整合; 掌握ClickHouse架构、速度快的原因;掌握ClickHouse数据库和表引擎;掌握ClickHouse基本操作以及和spark、flink的整合; 掌握旅游行业业务流程;掌握Flink在实时计算业务中的使用;掌握自定义Flink source和sink来生成和消费Kafka数据;掌握Flink和ClickHouse整合已存储数据;掌握搜索引擎Elasticsearch;掌握Flink和Elasticsearch整合;掌握基于Flink CEP处理复杂事件 职业方向: Flink开发工程师、实时开发工程师、实时数仓工程师 |

第五阶段 项目实战 | 项目实战: EWR消费信用风险舆情系统、Monoceros物流大数据平台、物流Kubernetes+Docker项目迁移 培养方向: 掌握信贷金融业务处理流程;掌握根据业务制定合理的技术框架(技术选型);掌握当下流行的数据中台概念;掌握前台工作整体机制以及技术应用;掌握后台综合分析展示应用系统;掌握大量数据的综合采集方案;掌握大量数据的ETL处理方式;掌握工作流调度解决方案;掌握集群指标监控工具的使用; 掌握基于亿级订单的物流大数据平台的研发;掌握基于Flink实现仓库货物、仓储车运动轨迹、包裹追踪等多维度业务分析;具备基于HDP平台收集数据资源的能力,实现秒级OLAP分析; 掌握Docker容器化技术以及应用;掌握Kubernetes核心功能以及在项目中的部署应用 职业方向: 数据仓库工程师、ETL开发工程师、离线开发工程师、实时开发工程师、数据中台工程师 |

第六阶段 就业指导 | 就业指导: 企业面试前期准备与技巧、专业指导、企业面试复盘 课程内容: 职业规划讲解、简历注意事项详解、就业情况分析简历制作(个人技能、项目经验、自我评价); 简历审核修正、常见面试题的讲解、技术简历的指导与优化、强化实战项目(项目模块的介绍,业务流程的梳理); 真实面试复盘(晚自习时间)(总结学员面试中的问题,进行针对性的辅导以及相关面试题的讲解) 培养方向: 从简历、面试技巧等层面助力学员,培养学员沟通表达能力 让学员清晰了解职业发展规划,明确自身定位,找到适合自身发展的工作; 通过项目强化、面试专项指导、面试复盘等,学员能更好就业 |

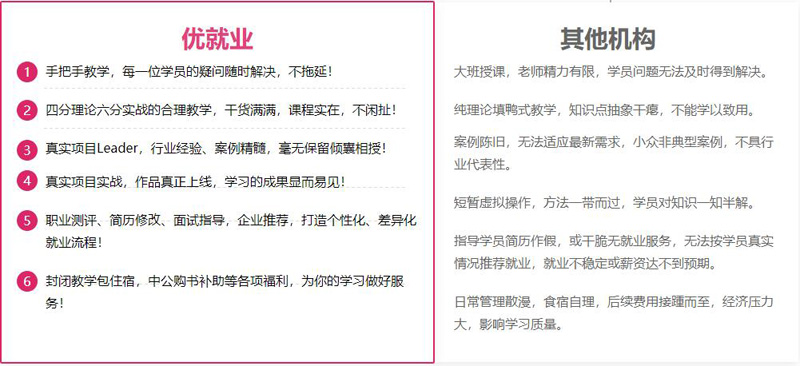

一路暖心服务,不怕您货比三家

大数据培训资料

近些年来,坊间一直流传着这样的言论:“大数据时代,人人都在裸奔”。对于外行人来说,对于“大数据”这个词最直观的理解就是“大的数据集”,这样理解是没有错的,但对于行内人来说,这样的理解就太过苍白了。

大数据究竟指的是什么?

答:大数据是指在一定时间内无法用常规软件工具对其内容进行抓取、管理和处理的数据集合。

适用于大数据的技术有哪些?

答:1、数据挖掘;

2、分布式文件系统;

3、大规模并行处理(MPP)数据库;

4、分布式数据库;

5、云计算平台;

6、互联网和可扩展的存储系统;

大数据组件

大数据的组件有很多,且随着时间的推移有些组件不再流行,我这里不能一一列举,只列举一些常见的组件:

Hadoop:一种分布式系统基础架构包含Hdfs、MapReduce、Yarn三大组件;

Hadoop-Hdfs:一种分布式文件系统,具有高容错、高伸缩的特点;

Hadoop-MapReduce:一种分布式编程模型,是基于Yarn的大数据并行处理系统;

Hadoop-Yarn:是一种用于作业调度和集群资源管理的框架;

Hive:一种基于Hadoop的数据仓库系统,它实现了使用类SQL的查询语言,能够方便地进行数据汇总、特定查询和分析文件系统中的大数据,在大数据平台中Hive主要主要解决数据处理和计算问题,一般是配合其他组件使用;

Hbase:一种分布的、可伸缩的大数据存储库(注意,Hive不能算存储库),通常Hdfs为其提供高可靠性的底层存储支持,它主要被用来解决实时数据查询问题,支持随机、实时的读写访问;

Pig:是一个平台,用来分析大数据集,Pig平台是由一种表达数据分析程序的高级语言和对这些程序进行评估的基础设施一起组成;

Sqoop:是一种高效传输批量数据的工具,主要用于Hadoop和结构化数据库之间的数据传输;

Kettle:是一种完成数据抽取、转换、装载(ETL)过程的工具,它支持图形化的GUI设计界面,然后可以以工作流的形式流转,在做一些简单或复杂的数据抽取、质量检测、数据清洗、数据转换、数据过滤等方面有着比较稳定的表现;

Flume:是一种分布式、有用且可靠的服务,该服务常用于高效收集、汇总、移动大量数日志数据;

Logstash:一个开源数据收集引擎,具有实时管道功能,它可以动态地将来自不同数据源的数据统一起来,并将数据标准化到你所选择的目的地,与ElasticSearch、Kibana并称ELK;

Zookeeper:一个分布式的、开放源码的分布式应用程序协调服务,该服务用于维护配置信息、提供分布式同步以及分组等事务;

Mahout:一种基于Hadoop的机器学习和数据挖掘的分布式计算框架算法集,实现了多种MapReduce模式的数据挖掘算法;

Spark:一种开源的数据分析集群计算框架,建立与分布式文件系统(Hdfs)只上(常与Hive相结合),与Hadoop一样,用语构建大规模、低延迟的数据分析应用,Spark采用scala语言实现,使用scala作为应用框架;

Storm:一种分布式的、高容错的实时计算系统,它属于流处理平台,多用于实时计算并更新数据库;

Shark:即前面提到的Hive On Spark,一个专为Spark打造的大规模数据仓库系统,兼容Hive,无需修改现有的数据或者查询,就可以用100倍的速度执行HiveSql,Shark支持Hive查询语言、无存储、序列化格式及自定义函数,与现有的数据仓库系统(Hive)无缝集成,是一个更快、更强大的替代方案;

Hue:一个开源的Hadoop UI系统,能够做HiveSql编辑器、搜索引擎Solr的各种图表以及与Oozie集成,可进行workflow的编辑、查看;

Oozie:一种任务调度框架,可与Hue集成,用来完成工作流的设计、录入、触发与监控等;

Phoenix:一个构建在大数据存储库(Hbase)只上的Sql中间层,完全使用java编写,提供了一个客户端可嵌入的JDBC(数据库连接,由java编写的类及接口组成)驱动,它的查询引擎会将Sql转换成一个或多个Hbase scan,并编排执行以生成标准的数据库连接(JDBC)结果集,Phoenix直接使用Hbase API、协同处理器与自定义过滤器,对于简单的查询来说,其性能量级是毫秒,对于百万级别的行数来说,其性能量级是秒;

Tez:一个基于作业调度和集群资源管理的框架(Yarn)之上的DAG(有向无环图)计算框架,他把MapReduce拆分成若干个子过程,同时又把若干个MapReduce组合成一个较大的DAG(有向无环图)任务,减少了MapReduce之间的文件存储(落地),同时合理组合其子过程,减少任务运行时间;

Kafka:一个分布式、支持分区的(partition)、多副本的(replica),基于zookeeper协调的分布式消息系统,它的最大的特性就是可以实时的处理大量数据以满足各种需求场景;

Ambari:作为Hadoop集群的一个供应、管理和监视的开源框架,该开源框架提供一个直观的操作工具和一系列健壮的Hadoop API,可吟唱负责的Hadoop相关操作,使集群操作大大简化;

CDH:是Hadoop众多分支中的一种,由Cloudera维护,基于稳定版本的Apache Hadoop构建,提供了Hadoop的核心可扩展存储(HDFS)和分布式计算(MR),还提供了WEB页面进行管理、监控;

扫描二维码免费领取试听课程

登录51乐学网

注册51乐学网